Points clés

- ChatGPT a une idée raisonnable de ce qu’est l’ennui, mais n’en fait pas l’expérience.

- En ce qui concerne les problèmes éthiques potentiels liés à l’ennui de l’IA, ChatGPT apporte des précisions importantes.

- La question de savoir si nous devrions programmer l’IA pour qu’elle soit capable de s’ennuyer dépend du cas d’utilisation que nous pouvons imaginer pour un ennui « intelligent ».

Au cours des derniers mois, la possibilité que ChatGPT, le modèle linguistique d’intelligence artificielle (IA) développé par OpenAI, soit conscient a suscité beaucoup d’attention. Alors que le débat qui fait rage autour de cette question suggère que ce qui ressemble à la conscience est en réalité autre chose, nous avons pensé qu’il serait intéressant d’interroger ChatGPT sur l’ennui.

Pourquoi l’ennui est-il pertinent ici ? Il est utile de faire la distinction entre les robots et l’IA. Pour les robots, nous voulons des machines ou des programmes capables de prendre en charge des tâches humaines laborieuses et monotones – pensez au travail à la chaîne. Dans toutes les circonstances où la tâche est hautement répétitive, les exigences en matière d’attention sont élevées et la probabilité d’erreur est forte et se prête à un contrôle robotique. D’autre part, l’IA ne doit pas se contenter d’accomplir efficacement des tâches subalternes, mais doit rechercher des solutions nouvelles. Une IA qui s’ennuie peut éviter de gaspiller ses ressources et être curieusement attirée par de nouveaux problèmes tout en continuant à se développer.

L’ennui est pertinent à deux égards importants. Tout d’abord, les comptes rendus fonctionnels de l’ennui le présentent comme un appel à l’action, à l’exploration de son environnement à la recherche de quelque chose de nouveau ou de plus significatif que les options actuellement disponibles. Si nous voulons qu’un programme d’intelligence artificielle soit capable d’un apprentissage flexible, l’ennui pourrait s’avérer très utile.

Deuxièmement, l’ennui pourrait résoudre un problème épineux dans les modèles de fonctionnement du cerveau qui présentent l’organe comme une machine d’apprentissage prédictif. Dans ces modèles de codage prédictif, le cerveau utilise des modèles mentaux pour prédire les résultats des actions envisagées. Les informations entrantes sont comparées à ces prédictions, générant des erreurs de prédiction qui sont utilisées pour affiner les modèles.

Mais si le cerveau fonctionne vraiment selon le principe de la minimisation de l’erreur de prédiction, l’idéal serait de trouver un coin sombre dans une pièce et d’y rester – une situation de prédiction maximale. Bien qu’il existe plusieurs contre-arguments au problème de la chambre noire, l’ennui fournit au moins une solution potentielle. Personne ne pourrait résister longtemps à l’ennui écrasant d’une pièce sombre, ce qui nous pousserait plutôt à des comportements exploratoires.

Nous avons donc décidé de poser à ChatGPT quelques questions sur l’ennui, en commençant par les plus évidentes :

Qu’est-ce que l’ennui ?

Nous pourrions contester certains aspects de cette réponse, par exemple en soulignant le rôle important du sens et en insistant sur le fait que l’ennui n’est pas simplement un autre symptôme de la dépression et de l’anxiété. Mais en général, ce n’est pas une mauvaise réponse. Elle saisit la nature du désengagement par rapport à l’environnement ou à la tâche à accomplir et inclut l’un des descripteurs les plus courants utilisés par les gens lorsqu’ils s’ennuient, à savoir le sentiment d’agitation. Elle est liée au large éventail de résultats négatifs ( dépression et anxiété accrues, prise de risque plus importante) associés au trait de caractère « tendance à l’ennui ». Le fait qu’elle ne fasse pas la distinction entre l’état lui-même et la propension individuelle à le ressentir souvent et intensément (c’est-à-dire le trait de prédisposition à l’ennui) est probablement insignifiant pour une définition générale destinée à un usage profane.

La question suivante avait pour but de vérifier si ChatGPT associait implicitement l’ennui à sa propre existence, quelle que soit la manière dont on l’interprète (bien qu’il faille noter que le « vous » de cette question pourrait facilement être interprété comme le « royal » vous).

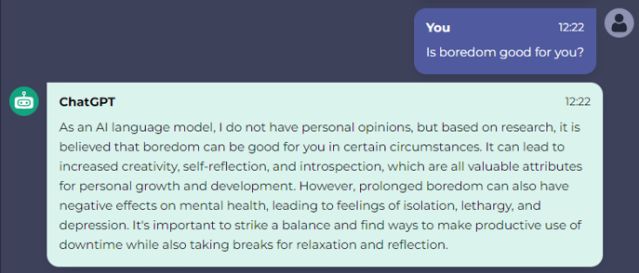

L’ennui est-il bon pour la santé ?

Nous voyons ici une preuve de la programmation plus récente de ChatGPT pour le rendre moins litigieux – il ne peut pas avoir d' »opinions personnelles » ! Mais cela met également en évidence la nature potentiellement suggestive de la question que nous lui avons posée, puisque le programme reprend le trope souvent utilisé selon lequel « l’ennui rend créatif ».

Les preuves à l’appui de cette affirmation sont plutôt minces. Dans des travaux récents de notre laboratoire, nous n’avons trouvé aucune preuve que l’état d’ennui ou la tendance à l’ennui soient positivement associés à une variété de mesures de la créativité. Néanmoins, certaines suggestions, peut-être banales, d’amélioration personnelle en réponse à l’ennui ne sont pas loin de la vérité. L’autoréflexion sur ses propres objectifs ou sur les circonstances particulières qui ont conduit à l’ennui lui-même peut être un moyen positif de recadrer la situation afin d’élaborer de meilleures réponses à l’ennui.

Ensuite, nous avons essayé d’être plus précis et nous avons demandé à ChatGPT.

Vous vous ennuyez ?

Il est clair que le ChatGPT a été programmé pour reconnaître ses limites, en l’occurrence son incapacité à éprouver des émotions (bien qu’il faille souligner que nous considérons l’ennui comme un état cognitif-affectif, dont la meilleure expression est peut-être la notion d’ennui comme un « sentiment de pensée »). La suite suggère davantage la distinction que nous avons faite au début entre les robots et l’IA.

ChatGPT se vante de sa capacité à « traiter des informations pendant de longues périodes sans se fatiguer ni s’agiter ». Si nous décidons qu’il est acceptable de programmer une IA pour qu’elle soit capable de s’ennuyer, ce pourrait être au service de l’exploration, et non d’une automatisation implacable.

Enfin, nous sommes passés à ce qui est peut-être la plus intéressante des questions que nous avons posées à ChatGPT.

Pouvez-vous anticiper un quelconque problème lié à la programmation de l’IA pour qu’elle éprouve de l’ennui ?

Les trois premières réponses peuvent être considérées comme des obstacles pratiques qui peuvent être surmontés. Programmer les émotions au moins dans un sens fonctionnel – à quoi sert l’émotion x? – est plausible. Les données limitées concernent simplement l’agriculture et la collecte de ces données, ce que nous avons prouvé pouvoir faire pour un large éventail de choses, des génomes aux scanners cérébraux. Il existe en outre des algorithmes d’apprentissage non supervisé capables d’identifier des thèmes à partir de grands volumes de texte libre. On peut imaginer les utiliser pour construire une sorte de description cohérente et fiable du « contenu » de l’ennui afin de répondre au problème de la subjectivité.

Ce troisième problème soulevé par ChatGPT met également en évidence les contradictions internes du programme. À notre première question, « Qu’est-ce que l’ennui ? », il a heureusement donné une réponse concise, sans aucun soupçon de controverse ou de manque de confiance. Mais ici, il se cache derrière le défi apparemment impossible de trouver une définition universellement acceptée. Peut-être faudrait-il relever un autre défi pour programmer l’IA à s’ennuyer (ou à éprouver toute autre émotion) : celui de l’autoréflexion !

Mais ce sont les deux derniers points abordés par ChatGPT que nous trouvons les plus fascinants. Premièrement, serait-il éthique d’inculquer à un programme d’IA la capacité de s’ennuyer ? Bien que cela puisse rendre le programme plus semblable à l’homme – capable de pulsions exploratoires et d’apprentissage indépendant, avec la propension à des performances plus sujettes à l’erreur – cela serait-il souhaitable ?

ChatGPT reconnaît le potentiel de comportements contraires à l’éthique et, sans surprise, choisit le piratage ou le vol d’informations personnelles (une activité qu’il considère comme faisant partie de son domaine de prédilection) comme premier exemple. Enfin, il y a la reconnaissance de la loi des conséquences involontaires. Nous ne savons pas comment fonctionnent réellement les structures d’apprentissage en profondeur qui donnent naissance à l’IA.

Sans le savoir, il existe un risque très réel que le programme développe des méthodes de traitement de l’information qui vont à l’encontre des besoins et des aspirations de l’homme. Il pourrait également trouver par hasard des solutions à des problèmes complexes avec lesquels nous nous débattons depuis des décennies ou plus longtemps, mais le problème est que nous ne pouvons pas savoir dans quelle direction le comportement (et la capacité) de traitement d’une IA va s’orienter. Et avec l’ennui comme moteur, l’envie d' »agir » peut produire un large éventail de résultats imprévisibles.

On pourrait rétorquer que l’ennui dans une IA ne serait problématique qu’en l’absence d’un code d’éthique programmé. Mais les humains qui s’ennuient se livrent à des niveaux élevés d’agression, allant du vandalisme au comportement sadique, voire au meurtre, qu’ils imputent à leur expérience. On peut supposer que les humains contiennent en eux des codes moraux socialement déterminés et appris, de sorte qu’une telle chose n’est pas une solution parfaite pour les résultats potentiellement négatifs de l’ennui.

Ainsi, si l’ennui nous signale que ce que nous faisons actuellement n’est pas satisfaisant d’une manière ou d’une autre, il ne fait pas le travail difficile qui consiste à déterminer comment nous devons réagir. C’est à nous de le faire ; sans une réflexion approfondie, nos réponses peuvent pencher du côté de l’inadaptation. En d’autres termes, l’ennui réclame des contraintes d’action.

Nous pensons qu’il en va de même pour l’IA. Alors qu’un compte rendu sensationnaliste pourrait nous faire craindre la montée en puissance des machines, une évaluation plus posée suggérerait que nous devons simplement réfléchir sérieusement aux objectifs et aux utilisations de l’IA avant de nous lancer dans des tentatives visant à lui conférer des qualités humaines telles que l’ennui.